Auch Innenminister Gerhard Karner besuchte das AIT, um sich im Kontext des nationalen Aktionsplans Deepfake über neue medienforensische Werkzeuge zu informieren (Bildcredit: BMI/Karl Schober)

Im Forschungsprojekt defalsif-AI (Detektion von Falschinformation mittels Artificial Intelligence), das im KIRAS Sicherheitsforschungsförderprogramm des BMLRT finanziert und durch das AIT Austrian Institute of Technology im Center for Digital Safety & Security koordiniert wird, wird eine medienforensische Softwareplattform entwickelt, die Anwender:innen bei z.B. Medienunternehmen oder Institutionen der öffentlichen Verwaltung eine Einschätzung der Glaubwürdigkeit von Text , Bild , Video- oder Audiomaterial im Internet erlauben soll. Zum Einsatz kommt dabei Künstliche Intelligenz (KI). Das Projekt fokussiert insbesondere auf politisch motivierte Desinformation. Denn diese schwächt bzw. bedroht letztlich die Demokratie und das öffentliche Vertrauen in politische und staatliche Institutionen.

"Wir entwickeln ein Tool, mit dem Mediennutzer:innen Falschinformationen erkennen können", so AIT Projektleiter und Senior Research Engineer Martin Boyer. Denn die Manipulation von Videos, Fotos und Texten ist längst nicht mehr Sache von Geheimdienstprofis. Das Werkzeug dazu hat theoretisch jeder auf seinem Rechner und Anleitungen sind im Netz leicht zu finden. Auch die Herstellung von sogenannten Deep Fakes, also Videos, in denen Personen – vornehmlich Politiker:innen – täuschend echt Aussagen in den Mund gelegt werden, die sie so nie getätigt haben, ist heute nicht mehr schwierig. Und solche Inhalte lassen sich, im Gegensatz zu herkömmlichen Medien wie z.B. Zeitungen oder Radio, deren Inhalte einen Verifikationsprozess durchlaufen, online mit einem einzigen Klick rasend schnell verbreiten.

Damit man solche gefakten Inhalte frühzeitig erkennt, soll das neue AIT-Tool Hilfestellung geben. Schöpft ein:e Anwender:in Verdacht, gibt die Software eine entsprechende Einschätzung ab, nachdem sie auf den jeweiligen Medieninhalt angesetzt wurde. Verschiedene Analysemodule und Algorithmen der KI überprüfen daraufhin den Inhalt. Davon ausgehend schätzt das Tool die Wahrscheinlichkeit ein, ob es sich um Fake-News handelt. Das Tool unterstützt, die Letztentscheidung, ob ein Inhalt als manipuliert einzustufen ist oder nicht, trifft aber letztlich nur der Mensch.

Der Österreichische Rundfunk (ORF) berichtet darüber im aktuellen Report (Video): Getäuschte Öffentlichkeit

- Weitere Informationen zum Projekt: https://www.defalsifai.at/

- Weitere Informationen zu KIRAS: https://www.kiras.at/

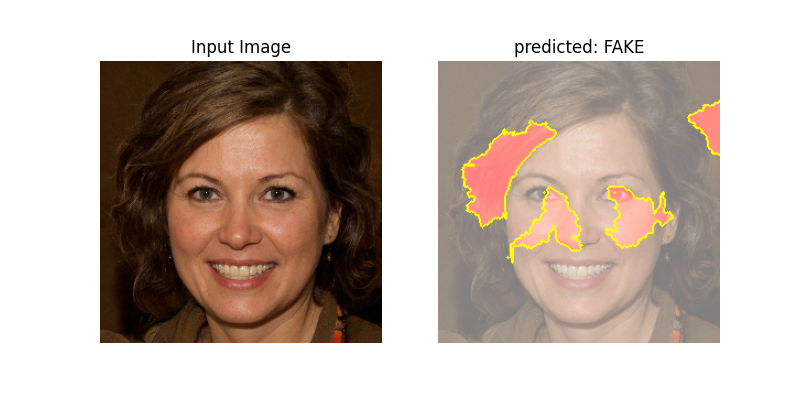

Bei diesem Bild handelt es sich um eine mittels Künstlicher Intelligenz erstellte Identität, eine Person, die es in Wirklichkeit nicht gibt. Die am AIT entwickelte medienforensische Software erkennt das Fake. (Credit: AIT)